黑帽 SEO 手法揭密 了解風險並堅持白帽 SEO 優化策略

身為一個在Google搜尋引擎優化領域打滾多年的獨立站經營者,我每天都會看到許多網站為了快速獲得排名而走捷徑,最終卻付出慘痛代價。今天,我想深入揭開那些看似有效、實則充滿風險的「黑帽」手法,並對比真正能讓網站持久成長的「白帽」策略。我的目標很明確:幫助你徹底了解黑帽SEO的潛在風險,並說服你堅持走正確的白帽優化道路。這不僅是為了符合搜尋引擎的規則,更是為了你的品牌信譽與長遠經營打下堅實基礎。在這篇文章中,我會分享真實的觀察、具體的案例比較,以及來自業界專家的實用建議,讓你一次掌握其中的關鍵差異。

黑帽SEO常見手法全解析:誘人捷徑背後的真相

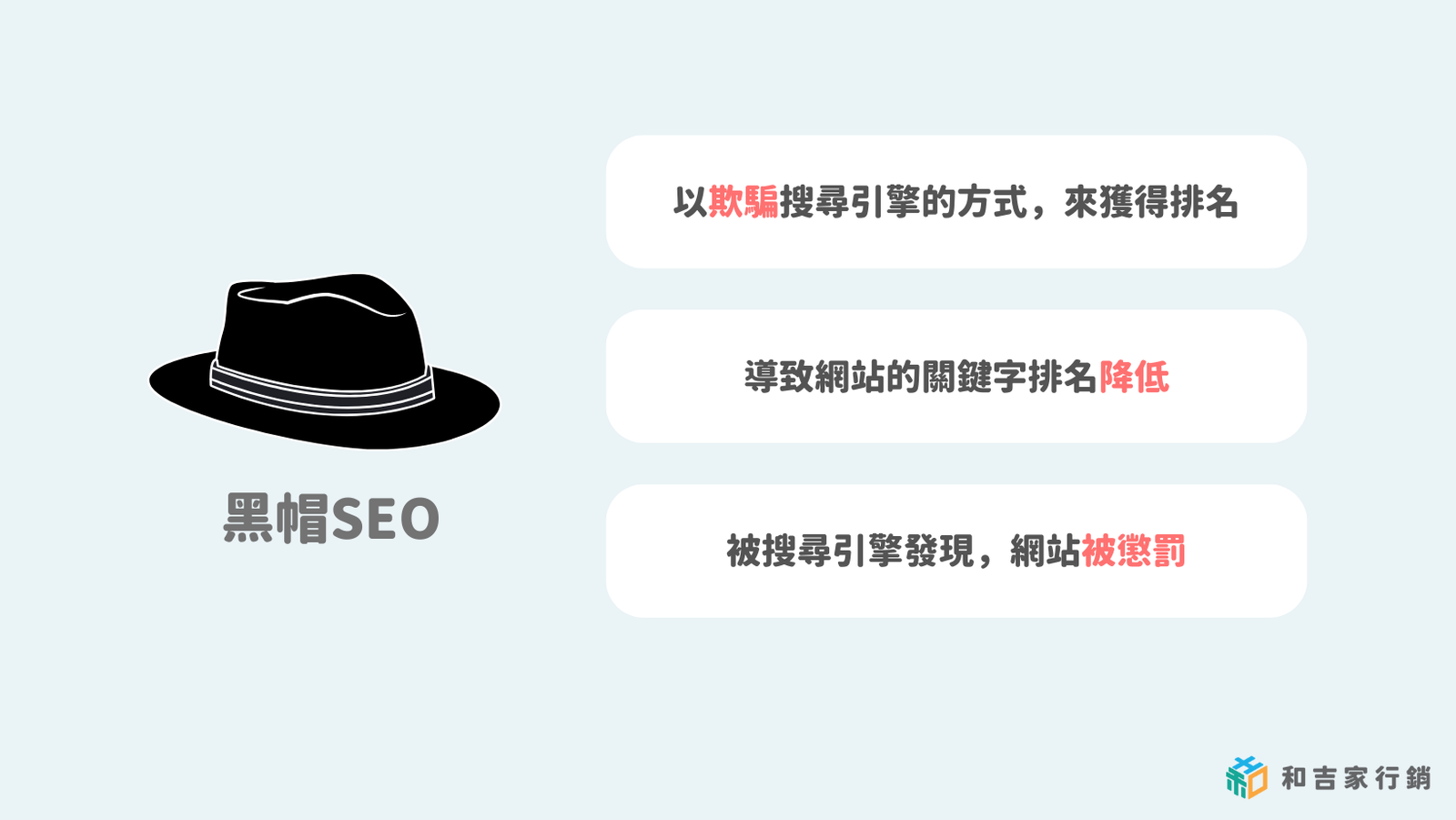

首先,我們必須清楚認識什麼是黑帽手法。簡單來說,這些都是試圖欺騙搜尋引擎演算法、違反其服務條款的技術。它們可能短期內讓排名飆升,但就像蓋在沙灘上的城堡,隨時可能崩塌。

關鍵字填充與隱藏文字

這是最古老的手法之一,操作者會在網頁中大量堆砌關鍵字,甚至將文字顏色設成與背景相同,讓使用者看不見,但搜尋引擎爬蟲卻能讀取。例如,一個賣茶的網站,可能在頁尾不斷重複「台灣高山茶、烏龍茶、綠茶、買茶葉、茶葉推薦…」等字串。Google的演算法早已能輕易識別這種不自然的關鍵字密度,一旦被偵測到,網站排名將會大幅下滑,甚至被直接從索引中移除。

門頁與偽裝技術

門頁是指為了某個特定關鍵字快速排名而大量建立的低質量頁面,內容通常單薄且重複性高。偽裝技術則是展示給搜尋引擎爬蟲的內容,與實際使用者看到的完全不同。這嚴重破壞了搜尋結果的公正性與使用者體驗。根據搜尋引擎的官方指引,這類刻意誤導的行為是明確禁止的。

大量購買低質量反向連結

連結一直是排名的重要信號之一。黑帽操作者會透過連結農場、大量論壇簽名檔、或是付費購買來自無關低質網站的連結,試圖快速提升網站的權重。然而,Google的「企鵝演算法」更新正是為了打擊這類操縱連結的行為。這些低質量連結不僅無助於排名,更會讓網站被標記為垃圾連結的對象,導致處罰。

自動生成與抄襲內容

為了快速產生大量內容,有些人會使用自動化軟體拼湊文章,或是直接抄襲、重寫他人的原創內容。這類內容通常語句不通、缺乏深度,無法提供任何價值給讀者。在Google強調「內容為王」與E-A-T(專業、權威、可信)原則的今天,這類網站幾乎不可能獲得好的排名。

為什麼黑帽SEO是條死胡同?深入剖析其巨大風險

了解手法後,我們必須正視選擇黑帽策略所帶來的後果。這些風險不僅是理論上的,更是許多網站真實經歷的慘痛教訓。

最直接的風險就是來自搜尋引擎的懲罰。這可能從關鍵字排名小幅下降開始,到整站排名消失(俗稱「沙盒效應」),最嚴重則是整個網域被從搜尋結果中徹底刪除。一旦遭受懲罰,恢復過程漫長且艱辛,需要提交重新審核請求並徹底清理所有違規手法,成功率也並非百分之百。

其次,品牌信譽將遭受毀滅性打擊。當使用者點進一個充滿關鍵字堆砌、內容空洞或甚至是偽裝的網站時,他們會立刻關閉視窗,並對該品牌產生極不信任的感覺。這種負面體驗會反映在網站的跳出率、停留時間等數據上,而這些數據本身也是搜尋引擎評判網站品質的指標,形成惡性循環。

從投資報酬率來看,黑帽SEO也是一項糟糕的投資。你投入金錢與時間建立的大量門頁、購買的垃圾連結,可能在一次演算法更新後就化為烏有。相反地,白帽策略的成果是累積性的,時間越久,基礎越穩固。根據一份關於網站流量可持續性的報告指出,遵循白帽原則的網站,其流量在演算法更新時表現出顯著的穩定性,而依賴黑帽手法的網站流量則呈現劇烈波動甚至斷崖式下跌。

白帽SEO核心策略:打造持久流量的堅實基礎

那麼,什麼才是正確且可持續的做法呢?白帽SEO的核心思想很簡單:一切以提供價值給「使用者」為中心,並遵循搜尋引擎的指南。這不是捷徑,而是一套系統性的長期經營哲學。

創造高價值、以使用者為中心的內容

內容永遠是基石。你需要創作真正能解決使用者問題、提供獨特見解或娛樂價值的原創內容。這意味著你需要深入研究目標族群的搜尋意圖。例如,當使用者搜尋「如何沖泡冷泡茶」,他的意圖可能是學習步驟、了解最佳茶葉與水比例、或是尋找推薦的茶具。你的文章就應該全面、清晰地滿足這些需求。

在撰寫時,自然地使用主要關鍵字與其相關詞彙(例如在談冷泡茶時,自然帶入「浸泡時間」、「茶葉種類」、「冷藏」等詞),避免生硬填充。文章的結構要清晰易讀,多使用小標題、項目清單和圖片來說明。

建立自然且高相關性的連結檔案

白帽的連結建設策略,重點在於「自然」與「相關性」。與其購買連結,不如透過以下方式獲得:

- 創建值得被連結的內容:如深度的研究報告、實用的工具、精彩的資訊圖表。

- 與產業內的網站或部落客建立真實關係:進行資源互補或客座撰文。

- 善用本地商業目錄或相關協會網站:確保你的企業資訊出現在正確的權威平台上。

一個來自高權威、主題相關網站的自然推薦,其價值遠勝過一百個垃圾連結。

提供絕佳的技術與使用者體驗

一個網站如果載入速度慢、在手機上難以瀏覽、或連結結構混亂,即使內容再好也會讓使用者離開。確保你的網站:

- 擁有快速的載入速度(可透過Google的PageSpeed Insights工具檢測)。

- 採用響應式網頁設計,在所有裝置上都能完美顯示。

- 擁有清晰易懂的導航選單與網站結構,讓使用者和搜尋引擎都能輕鬆理解網站內容脈絡。

黑帽與白帽策略的終極比較

為了讓你更一目了然,我將兩者的核心差異整理成下表:

| 比較面向 | 黑帽SEO手法 | 白帽SEO策略 |

|---|---|---|

| 核心思想 | 欺騙搜尋引擎,快速獲取排名。 | 服務終端使用者,遵循官方指南。 |

| 效果特性 | 效果快速但短暫,高風險。 | 效果漸進但持久,風險極低。 |

| 長期影響 | 極可能導致懲罰,品牌信譽受損。 | 建立品牌權威與穩定流量基礎。 |

| 內容產出 | 常為自動生成、抄襲或低質量內容。 | 專注原創、高價值、解決問題的內容。 |

| 連結來源 | 購買、交換或來自連結農場的低質量連結。 | 透過優質內容自然獲取的高相關性連結。 |

| 投資回報 | 不穩定,可能血本無歸。 | 穩定累積,時間越長回報越高。 |

專家觀點:為什麼堅持白帽是唯一明智的選擇?

許多業內的資深專家都對此有深刻見解。知名的搜尋引擎行銷專家曾多次公開強調,搜尋引擎持續更新的最終目的,就是為了獎勵那些為使用者提供最佳體驗的網站。每一次的演算法更新,其實都是在縮短黑帽手法的壽命,並讓白帽策略的優勢更加凸顯。

另一位專注於網站分析的顧問則從數據角度指出,他們的客戶中,那些專注於產出專業內容、優化網站技術架構的企業,其自然流量在三年內的成長幅度平均超過300%,且抵禦演算法更新的能力非常強。這證明了堅持正道雖然起步可能較慢,但卻是通往長期成功的唯一可靠路徑。

實戰心法:如何開始執行你的白帽優化計畫?

理論說完,我們來談具體行動。作為一個獨立站經營者,你可以從今天開始執行以下步驟:

- 進行關鍵字與意圖研究:使用關鍵字規劃工具,找出與你業務相關且具有搜尋量的詞組,並仔細分析每個詞背後的用戶意圖是資訊型、商業型還是交易型。

- 規劃內容藍圖:根據關鍵字意圖,規劃一系列能完整覆蓋使用者問題的內容主題,例如教學文章、產品比較、深度評測等。

- 優化網站技術基礎:檢查並改善網站速度、確保行動裝置友善性、建立清晰的網站結構(善用麵包屑導覽)。

- 有策略地建立連結:從創作一份業內頂尖的終極指南開始,然後禮貌地告知相關領域的內容創作者,這份資源可能對他們的讀者有幫助。

- 定期監測與調整:使用搜尋控制台與分析工具,觀察你的流量變化、排名狀況與使用者行為,並據此調整你的內容與策略。

記住,搜尋引擎優化是一場馬拉松,不是百米衝刺。你的耐心與堅持,將會體現在網站穩健成長的流量與品牌影響力上。

常見問題解答

問:如果我的競爭對手都在用黑帽手法而且排名很好,我該怎麼辦?

答:請保持耐心。這種情況通常不會長久。你可以將對手的網站作為參考,了解他們滿足了用戶的哪些需求,然後創作出更全面、更優質的內容來超越他們。搜尋引擎的更新最終會獎勵真正的優質網站。

問:白帽SEO效果太慢了,有沒有加速的方法?

答:所謂的「加速」應建立在正確的基礎上。你可以透過加大高質量內容的產出頻率、積極進行有價值的公關活動或合作來增加品牌曝光、以及確保網站技術層面沒有任何拖慢速度的問題。這些都是安全且有效的促進方式。

問:如何判斷一個SEO服務商用的是白帽還是黑帽手法?

答可以詢問他們的具體策略。如果對方保證「快速排名」、「首頁保證」,或提及大量建立連結、購買連結等不透明做法,就需要高度警惕。正規的服務商會專注於內容策略、技術優化與自然連結建設,並會向你說明這是一個需要時間的過程。

問:我的網站曾經用過黑帽手法,現在該如何補救?

答:首先,立即停止所有黑帽操作。接著,使用搜尋控制台檢查是否有手動懲罰通知。然後,徹底清理網站上的垃圾內容、隱藏文字及移除你能控制的低質量反向連結(或透過搜尋控制台拒絕垃圾連結)。最後,開始專注產出高質量內容,並可能需提交重新審核請求。這是一個需要決心與時間的過程。

資料來源與參考文獻

1. Google Search Central,關於垃圾內容與品質指南的官方說明:https://developers.google.com/search/docs/essentials/spam-policies

2. Google Search Central,關於建立優質網站的一般性指南:https://developers.google.com/search/docs/fundamentals/creating-helpful-content

3. 產業分析報告:「The State of Organic Search Visibility: A Longitudinal Study」,該研究追蹤了數千個網站在多次演算法更新後的流量穩定性表現。